Entropia: curiosità, esperimenti e cosa sapere

Scopri cos'è l'entropia termodinamica e l'entropia di Shannon. Una guida completa tra esperimenti pratici, curiosità spaziali, il Diavolo di Maxwell e il destino dell'universo.

Cos'è l'entropia? Significato semplice e definizione

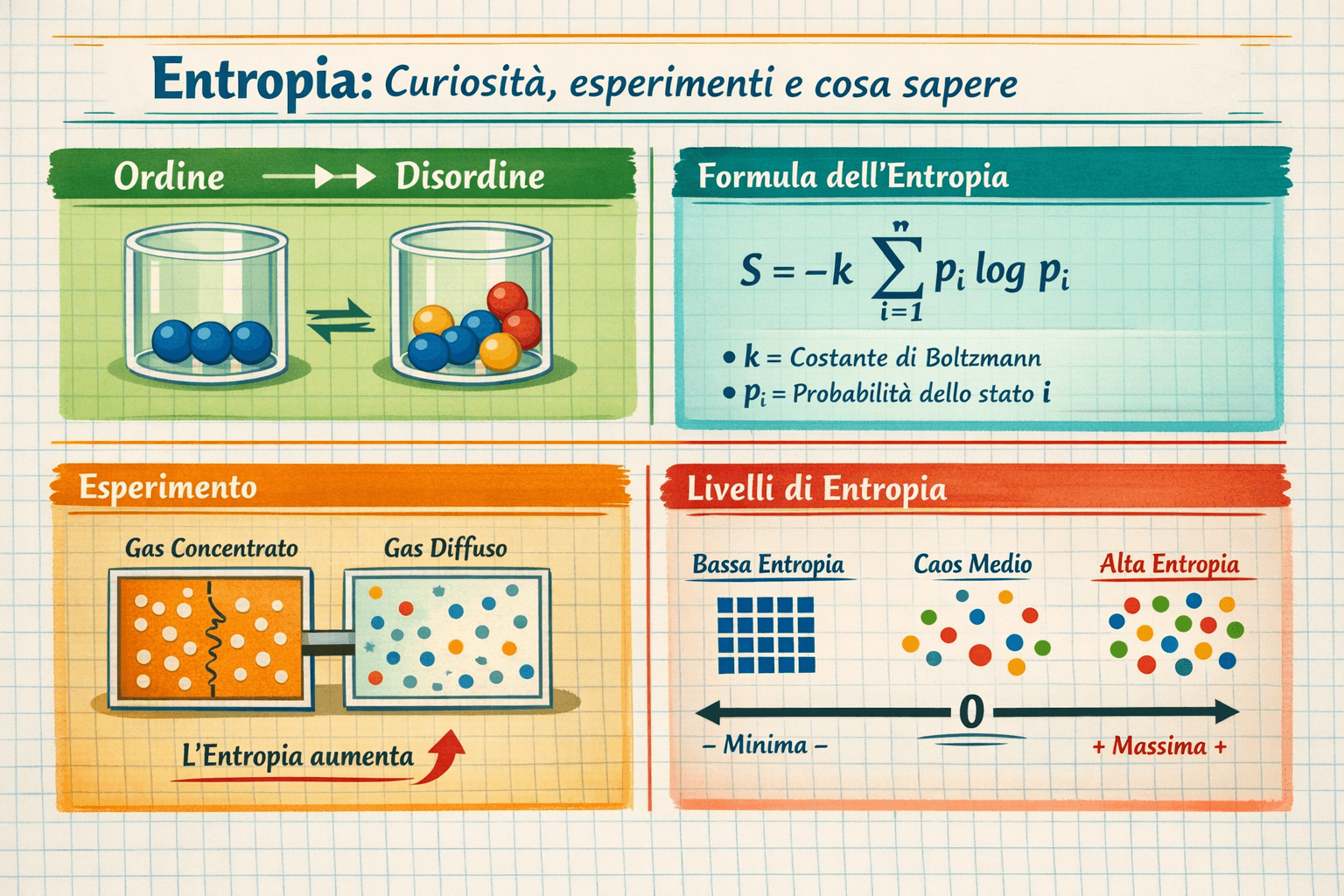

Quando ci si avventura nello studio della fisica o delle scienze informatiche, l'entropia rappresenta uno dei concetti più affascinanti e trasversali in assoluto. Per darne una definizione semplice, possiamo considerarla come la misura di quanto l'energia di un sistema sia dispersa e non più utilizzabile per compiere lavoro utile. Tuttavia, questa grandezza assume sfumature diverse a seconda del campo di studio: se l'entropia termodinamica descrive l'evoluzione dell'energia e della materia nel mondo fisico, l'entropia di Shannon misura l'incertezza e la quantità di dati in un messaggio. Comprendere questa distinzione è il primo passo per padroneggiare la materia.

La doppia natura: Termodinamica e Teoria dell'Informazione

Il concetto di entropia possiede una duplice anima che si manifesta in due rami fondamentali della scienza. Da un lato abbiamo la fisica classica e statistica, dall'altro la moderna teoria dell'informazione.

Per chiarire questa dicotomia, possiamo osservare le differenze principali nella seguente tabella riassuntiva:

| Caratteristica | Entropia Termodinamica (Clausius/Boltzmann) | Entropia di Shannon (Teoria dell'Informazione) |

|---|---|---|

| Ambito | Fisica, Chimica, Ingegneria | Informatica, Telecomunicazioni, Crittografia |

| Cosa misura | La dispersione dell'energia termica in un sistema | L'incertezza o la quantità di informazione in un messaggio |

| Unità di misura | Joule su Kelvin (J/K) | Bit, Nat o Shannon |

| Tendenza naturale | Aumenta in un sistema isolato (2° Principio) | Massimizzata quando tutti i messaggi sono equiprobabili |

Nonostante le differenze pratiche, le due concezioni sono profondamente legate dalla matematica della probabilità. Entrambe descrivono sistemi in cui la conoscenza esatta dello stato di ogni singola particella (o bit) è sostituita da una descrizione statistica globale.

Sfatare il falso mito del disordine: la molteplicità di microstati

Nelle aule scolastiche, l'entropia viene spesso liquidata con l'esempio della "camera in disordine". Questa analogia, per quanto intuitiva, è scientificamente imprecisa. In fisica statistica, introdotta da scienziati come Ludwig Boltzmann, l'entropia non misura il "caos" visivo, bensì il numero di microstati compatibili con un dato macrostato.

Un macrostato è la condizione generale di un sistema (ad esempio, un gas a una certa temperatura e pressione), mentre i microstati sono tutte le possibili disposizioni specifiche delle singole molecole che generano quel risultato globale. Più sono i modi in cui le particelle possono disporsi mantenendo invariato l'aspetto macroscopico, maggiore è l'entropia. Quando i sistemi fisici diventano complessi, calcolare le combinazioni e le permutazioni dei microstati richiede strumenti di calcolo combinatorio avanzati, per i quali può rivelarsi utile l'utilizzo di un valido strumento di calcolo matematico online per semplificare le equazioni fattoriali.

La dispersione dell'energia spiegata a tutti

Se abbandoniamo per un attimo le formule, possiamo visualizzare l'entropia come la tendenza inesorabile dell'energia a "sparpagliarsi". Immaginate una goccia di inchiostro lasciata cadere in un bicchiere d'acqua: inizialmente, l'inchiostro è concentrato in un punto (bassa entropia). Con il passare dei minuti, le molecole di inchiostro si diffondono casualmente fino a colorare uniformemente tutta l'acqua (alta entropia).

L'energia si comporta esattamente allo stesso modo. L'energia concentrata e altamente strutturata (come quella chimica contenuta in un pezzo di carbone) è molto utile perché può essere trasformata in lavoro. Tuttavia, quando bruciamo il carbone, quell'energia si disperde nell'ambiente sotto forma di calore, fumo e gas. La quantità totale di energia è rimasta la stessa (per il principio di conservazione), ma la sua "qualità" è degradata: non possiamo più usarla per muovere un treno. L'entropia misura esattamente questo grado di degradazione e dispersione dell'energia.

L'entropia termodinamica e il Secondo Principio

Comprendere la natura del calore richiede di definire con precisione l'entropia termodinamica, la grandezza che detta le regole di ciò che è fisicamente possibile nel nostro universo. A differenza dell'entropia di Shannon, che si applica ai bit di un computer, l'entropia in fisica è indissolubilmente legata al secondo principio della termodinamica. Questa legge fondamentale stabilisce un limite invalicabile all'efficienza delle macchine termiche e decreta che, a lungo termine, l'energia dell'universo è destinata a degradarsi, portando teoricamente alla cosiddetta morte termica dell'universo.

Gli enunciati di Kelvin-Planck e Clausius

Il secondo principio della termodinamica non è nato con una singola equazione, ma è stato originariamente formulato attraverso osservazioni empiriche sull'impossibilità di creare macchine perfette. I due enunciati storici più celebri sono:

- L'enunciato di Kelvin-Planck: È impossibile realizzare una trasformazione termodinamica il cui unico risultato sia quello di assorbire calore da un'unica sorgente e trasformarlo integralmente in lavoro meccanico. In parole povere: nessuna macchina termica può avere un rendimento del 100%. Una parte di calore dovrà sempre essere ceduta a un ambiente più freddo (aumentando l'entropia).

- L'enunciato di Clausius: È impossibile realizzare una trasformazione il cui unico risultato sia il passaggio di calore da un corpo più freddo a uno più caldo. Il calore fluisce sempre e solo spontaneamente dal caldo al freddo. Per invertire questo processo (come fa un frigorifero), è necessario compiere lavoro dall'esterno.

La formula di Clausius spiegata senza matematica complessa

Fu il fisico Rudolf Clausius a dare una veste matematica a queste osservazioni, coniando il termine stesso di "entropia". La variazione di entropia in una trasformazione reversibile è descritta da una formula apparentemente criptica, ma concettualmente elegante:

ΔS = ∫(dQ / T)

Per le trasformazioni isoterme (a temperatura costante), questa espressione integrale si semplifica notevolmente in: ΔS = Q / T

Cosa significa in pratica?

- ΔS è la variazione di entropia.

- Q è il calore scambiato dal sistema (misurato in Joule).

- T è la temperatura assoluta a cui avviene lo scambio (misurata in gradi Kelvin).

La formula ci dice che l'entropia aumenta quando forniamo calore a un sistema. Inoltre, ci mostra che la temperatura agisce come un fattore di "smorzamento": aggiungere una stessa quantità di calore a un corpo freddo provoca un aumento di entropia molto maggiore rispetto ad aggiungerla a un corpo già rovente, proprio come starnutire in una biblioteca silenziosa crea molto più disturbo che farlo in uno stadio affollato. Per un approfondimento storico e matematico su questa deduzione, è possibile consultare la pagina dedicata a Rudolf Clausius su Wikipedia.

Perché l'entropia di un sistema isolato è in costante aumento

Se consideriamo un sistema isolato (ovvero un sistema che non scambia né materia né energia con l'esterno, come l'intero Universo), il secondo principio stabilisce che la sua entropia non può mai diminuire: ΔS ≥ 0.

Questo accade perché i processi spontanei in natura avvengono sempre verso lo stato macroscopico più probabile, che è invariabilmente quello con il maggior numero di microstati. Le molecole di un gas all'aperto non si raduneranno mai spontaneamente tutte in un solo angolo della stanza, perché la probabilità statistica che ciò avvenga è talmente infinitesimale da essere considerata impossibile. Ogni reazione chimica, ogni attrito meccanico e ogni scambio di calore genera nuova entropia che non può essere distrutta, spingendo inesorabilmente il sistema verso uno stato di equilibrio termico totale.

La Freccia del Tempo: perché non possiamo tornare indietro?

Il concetto di entropia è l'unico fondamento fisico che spiega perché percepiamo il tempo scorrere in una sola direzione. Che si tratti dell'entropia termodinamica di una stella che brucia o, in senso lato, dell'entropia di Shannon nei sistemi complessi che elaborano dati, l'universo cambia in modo irreversibile. Questa asimmetria temporale è nota in fisica come la freccia del tempo, un principio che giustifica il continuo e inarrestabile aumento del disordine dell'universo a livello macroscopico.

Il legame tra aumento dell'entropia e scorrere del tempo

Le leggi fondamentali della fisica classica, della meccanica quantistica e della relatività sono, di per sé, simmetriche rispetto al tempo. Se guardassimo il video della collisione tra due palle da biliardo al rallentatore e lo riproducessimo al contrario, non noteremmo alcuna violazione delle leggi della dinamica di Newton: entrambe le sequenze sembrerebbero fisicamente plausibili.

Tuttavia, nella vita reale, sappiamo perfettamente distinguere il passato dal futuro. Se vediamo un bicchiere di vetro cadere e frantumarsi in mille pezzi, sappiamo che il video sta procedendo in avanti; se vediamo i cocci ricomporsi spontaneamente in un bicchiere intatto, sappiamo che il video è riavvolto. È proprio l'entropia a fungere da "orologio cosmico": il futuro è, per definizione, la direzione temporale in cui l'entropia complessiva dell'universo risulta maggiore rispetto al passato.

L'irreversibilità dei processi fisici spontanei

Nella fisica statistica avanzata, il passaggio da stati a bassa entropia a stati ad alta entropia viene spesso modellato attraverso catene di Markov. In questi modelli, le probabilità di transizione tra i vari stati di un sistema mostrano matematicamente perché l'inversione di un processo spontaneo sia statisticamente impossibile. Per analizzare scenari complessi con molte variabili di stato, fisici e ingegneri si affidano regolarmente al calcolo matriciale; un calcolatore di matrici diventa in questi casi uno strumento fondamentale per risolvere i sistemi lineari che descrivono l'evoluzione temporale del sistema.

I processi fisici spontanei sono irreversibili perché l'energia si degrada attraverso l'attrito, la resistenza elettrica e la dissipazione termica. L'unico modo per riportare un sistema locale al suo stato originario a bassa entropia (come congelare l'acqua per farne ghiaccio) è spendere energia dall'esterno, il che inevitabilmente genererà un aumento di entropia ancora maggiore nell'ambiente circostante.

La tazza di tè bollente e il flusso unidirezionale del calore

L'esempio più iconico della freccia del tempo è quello di una tazza di tè bollente lasciata su un tavolo in una stanza a temperatura ambiente. Osserviamo la sequenza logica degli eventi:

- Stato iniziale (Bassa entropia): Il tè è a 80°C, l'aria della stanza è a 20°C. C'è una chiara distinzione termica e spaziale dell'energia.

- Processo di scambio termico: Le molecole veloci del tè colpiscono le pareti della tazza e le molecole lente dell'aria circostante, cedendo loro energia cinetica.

- Stato finale (Alta entropia): Dopo qualche ora, sia il tè che la stanza si trovano alla stessa temperatura (equilibrio termico). L'energia si è sparpagliata uniformemente.

Non vedremo mai, in nessun caso, la tazza di tè assorbire spontaneamente calore dall'aria circostante per rimettersi a bollire mentre la stanza si raffredda. Questo flusso unidirezionale del calore, governato dal secondo principio della termodinamica, dimostra visivamente l'irreversibilità del tempo e il trionfo dell'entropia.

Oltre al classico esempio della bevanda che si raffredda, l'entropia pervade ogni singola azione che compiamo. L'entropia termodinamica non è un concetto astratto relegato ai laboratori di fisica, ma una presenza costante nella nostra vita quotidiana. Ogni volta che cuciniamo, guidiamo un'auto o semplicemente respiriamo, stiamo obbedendo al secondo principio della termodinamica, contribuendo al generale e inarrestabile aumento del disordine dell'universo.

In pratica, qualsiasi processo reale che comporti una trasformazione di energia genera una certa quantità di "scarto", solitamente sotto forma di calore non più utilizzabile. Questo degrado energetico è il motivo per cui il moto perpetuo è impossibile e perché ogni sistema isolato tende naturalmente verso lo squilibrio e il caos.

Vediamo come questa ineluttabile legge della fisica si manifesta negli oggetti che usiamo tutti i giorni.

Come funziona il frigorifero: usare il lavoro per invertire il flusso

A prima vista, un frigorifero potrebbe sembrare una macchina che viola le leggi della termodinamica: al suo interno l'aria si raffredda, abbassando la temperatura e riducendo l'entropia locale. L'acqua si trasforma in ghiaccio, passando da uno stato liquido disordinato a una struttura cristallina altamente ordinata. Come è possibile?

La risposta risiede nel fatto che il frigorifero non è un sistema isolato. Per "sconfiggere" temporaneamente la freccia del tempo al suo interno, deve compiere un lavoro meccanico:

- Il compressore utilizza energia elettrica per comprimere un gas refrigerante.

- Lo scambiatore di calore assorbe l'energia termica dai cibi all'interno della cella.

- La serpentina posteriore espelle questo calore nell'ambiente circostante.

Se misurassimo con precisione l'energia in gioco, scopriremmo che il calore dissipato nel retro del frigorifero aumenta l'entropia della cucina in misura molto maggiore rispetto alla diminuzione di entropia ottenuta all'interno dell'elettrodomestico. Il bilancio totale dell'universo rimane, come sempre, positivo.

L'usura dei materiali e l'invecchiamento

L'entropia si manifesta anche attraverso il degrado della materia nel tempo. Quando acquistiamo un'automobile nuova o uno smartphone, questi oggetti si trovano in uno stato di bassissima entropia: i loro atomi sono disposti in strutture ordinate e specifiche, progettate per svolgere funzioni precise.

Tuttavia, con il passare dei mesi e degli anni, l'ossigeno nell'aria causa la formazione di ruggine sulla carrozzeria, gli schermi si graffiano, le batterie perdono la loro capacità di immagazzinare carica. Anche l'invecchiamento biologico delle nostre cellule è una lenta ma inesorabile resa all'entropia termodinamica. Mantenere l'ordine richiede un costante dispendio di energia (attraverso l'alimentazione e la manutenzione), ma alla fine, le forze del disordine prevalgono sempre, disgregando le strutture complesse.

Il calore dissipato dai motori e dai computer

Ogni volta che utilizziamo un dispositivo tecnologico, stiamo assistendo a una massiccia produzione di entropia. I motori a combustione interna delle automobili sono notoriamente inefficienti: solo il 20-30% dell'energia chimica contenuta nella benzina viene trasformata in movimento (energia cinetica); il restante 70-80% viene sprecato sotto forma di gas di scarico, attrito meccanico e, soprattutto, calore radiante.

Lo stesso principio si applica all'elettronica. I processori dei computer e degli smartphone generano calore mentre eseguono miliardi di calcoli al secondo. L'energia elettrica necessaria per far funzionare i transistor si trasforma inevitabilmente in energia termica, rendendo necessarie ventole e dissipatori per evitare la fusione dei circuiti. Su scala cosmica, questa infinita e continua dissipazione termica da parte di ogni stella, pianeta e macchina è ciò che spinge lentamente la nostra realtà verso la cosiddetta morte termica dell'universo, uno stato finale di equilibrio in cui non vi sarà più alcuna energia utile per compiere lavoro.

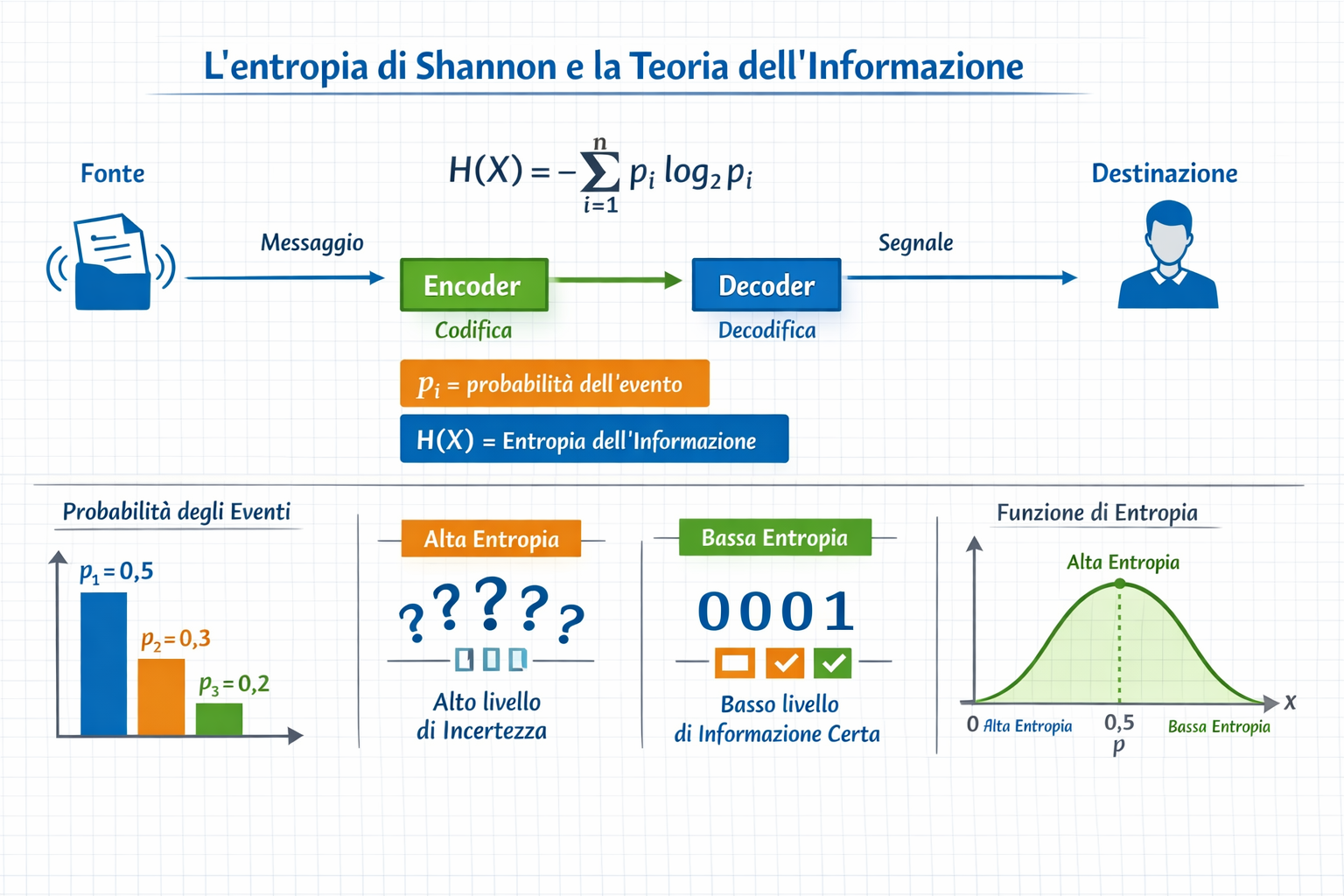

L'entropia di Shannon e la Teoria dell'Informazione

Spostandoci dal regno della fisica a quello dei dati, incontriamo un'altra faccia della stessa medaglia: l'entropia di Shannon. Introdotta nel 1948 dal matematico Claude Shannon, questa grandezza è il pilastro fondante della teoria dell'informazione. In questo contesto, l'entropia non descrive il calore o il disordine termico, ma quantifica l'incertezza, la sorpresa e la quantità di informazione contenuta in un messaggio.

Storicamente, questa intuizione ha permesso la nascita dell'era digitale. Senza le equazioni di Shannon, non esisterebbero gli algoritmi di compressione file (come i formati ZIP o MP3), né le moderne telecomunicazioni o le trasmissioni crittografate su internet. Per comprendere l'impatto di questa scoperta, si rimanda all'approfondimento sulla Teoria dell'informazione su Wikipedia.

L'entropia come misuratore di sorpresa e incertezza

In matematica, l'entropia dell'informazione si calcola utilizzando una formula logaritmica che valuta la probabilità dei vari stati di un sistema:

H = - Σ p(x) * log2(p(x))

In parole povere, questa formula ci dice che l'informazione è direttamente proporzionale alla "sorpresa". Se un evento è assolutamente certo (probabilità del 100%), la sua entropia è pari a zero: non c'è alcuna sorpresa, quindi non viene trasmessa alcuna nuova informazione. Al contrario, se un evento è altamente improbabile e imprevedibile, la sua realizzazione genera una grande sorpresa, portando con sé un alto contenuto informativo (un'alta entropia).

L'aneddoto di John von Neumann: perché Shannon scelse questo nome

Un aspetto curioso e affascinante riguarda proprio il nome di questa grandezza matematica. Quando Claude Shannon formulò la sua teoria, non era sicuro di come chiamare la sua nuova misura dell'incertezza. Pensò di usare termini come "informazione" o "incertezza", ma riteneva che fossero già troppo abusati nel linguaggio comune.

Si narra che Shannon chiese consiglio al brillante matematico John von Neumann, il quale gli diede un suggerimento geniale: "Dovresti chiamarla entropia, per due motivi. Primo, la tua funzione matematica è identica a quella della meccanica statistica. Secondo, e più importante, nessuno sa davvero cosa sia l'entropia, quindi in una discussione avrai sempre un netto vantaggio". Questo aneddoto illustra perfettamente il profondo e misterioso legame tra l'entropia termodinamica e l'elaborazione dei dati.

La differenza tra un messaggio prevedibile e uno informativo

Per capire a fondo la teoria di Shannon, dobbiamo separare il significato "umano" di un messaggio dal suo contenuto "matematico".

Consideriamo la frase: "Domani mattina il sole sorgerà a est". Per un essere umano è una frase di senso compiuto, ma dal punto di vista dell'entropia di Shannon, il suo valore informativo è quasi nullo. Sappiamo già che il sole sorge a est; la probabilità che accada è vicina al 100%, quindi il messaggio non ci sorprende e non ci fornisce dati nuovi.

Se invece riceviamo un messaggio con scritto: "I numeri vincenti della lotteria di oggi sono 4, 15, 23, 42, 55, 61", l'entropia schizza alle stelle. La probabilità di indovinare esattamente quella sequenza è infinitesimale. La ricezione di quel messaggio risolve un'enorme incertezza, fornendoci un'altissima quantità di informazione pura.

Esempi concreti di entropia dell'informazione

Per rendere ancora più tangibile il concetto di entropia, possiamo applicare la formula di Shannon a scenari di facile comprensione. Analizzando le probabilità e le aspettative, diventa evidente come l'entropia di Shannon sia, di fatto, il metro di misura della prevedibilità di un sistema.

Passiamo ad analizzare tre casi studio pratici che illustrano come varia il carico informativo in base alla distribuzione statistica degli eventi.

Il paradosso della scatola con le palline rosse e blu

Immaginiamo di avere una scatola opaca contenente 100 palline e di doverne estrarre una alla cieca. L'entropia del sistema cambia drasticamente in base alla composizione della scatola.

| Composizione Scatola | Probabilità (Rossa) | Probabilità (Blu) | Entropia (Risultato) |

|---|---|---|---|

| 100 Rosse, 0 Blu | 100% | 0% | 0 Bit (Certezza assoluta) |

| 99 Rosse, 1 Blu | 99% | 1% | ~0.08 Bit (Molto bassa) |

| 50 Rosse, 50 Blu | 50% | 50% | 1 Bit (Incertezza massima) |

Se la scatola contiene solo palline rosse, prima ancora di estrarre sappiamo già il risultato. L'estrazione non genera informazione. Se c'è una sola pallina blu, scommetteremo quasi sicuramente sulla rossa; l'incertezza è minima. Ma se la scatola contiene 50 palline rosse e 50 blu, non abbiamo alcun vantaggio predittivo: l'incertezza è massima, l'entropia è al suo picco (esattamente 1 bit di informazione per estrazione) e il risultato ci fornirà la massima "sorpresa" possibile.

Il libro con frasi ripetute vs il romanzo di avventure

Un altro esempio eccellente si trova nell'editoria e nella compressione dei dati. Immaginiamo un libro di 300 pagine in cui è stampata, per migliaia di volte, la stessa identica frase: "Il gatto è sul tavolo".

Questo testo ha un'entropia bassissima. Il vocabolario è limitato e la sequenza delle parole è assolutamente prevedibile. Se dovessimo salvare questo libro su un computer, un algoritmo di compressione (come un file ZIP) noterebbe la ripetizione e ridurrebbe le 300 pagine a pochi kilobyte di memoria, creando una regola logica ("ripeti questa frase 10.000 volte").

Al contrario, un romanzo fantasy ricco di colpi di scena, dialoghi complessi e descrizioni dettagliate ha un'entropia altissima. Le parole sono variegate, le lettere non seguono pattern ripetitivi banali e ogni pagina porta informazioni nuove. Un algoritmo di compressione faticherà molto di più a ridurre le dimensioni del file, perché non può "schiacciare" il disordine e la ricchezza informativa del testo senza rischiare di perdere dati fondamentali.

La gara di corsa: Usain Bolt contro atleti dilettanti

L'entropia si applica anche alle scommesse sportive. Immaginiamo una gara dei 100 metri piani in cui Usain Bolt, nel pieno della sua carriera, corre contro sette impiegati di banca scelti a caso.

L'esito della gara è altamente prevedibile. La probabilità che Bolt vinca rasenta il 100%. L'entropia di questo evento è vicina allo zero: guardare la gara non ci sorprenderà, confermerà solo ciò che già sapevamo.

Se invece modifichiamo lo scenario e mettiamo sulla linea di partenza gli otto uomini più veloci del mondo, tutti con tempi record personali distanti solo pochi millesimi di secondo l'uno dall'altro, la situazione cambia radicalmente. Nessuno può prevedere con certezza chi vincerà. L'esito della gara è un'incognita totale. In questo caso, l'entropia della gara è massima, e solo il superamento della linea del traguardo fornirà l'informazione necessaria a risolvere l'incertezza accumulata.

Proprio come l'esito di una gara sportiva o la trama di un libro possono essere analizzati in termini di imprevedibilità, questo stesso principio matematico governa le tecnologie più avanzate del nostro tempo. Passiamo ad analizzare come l'entropia di Shannon sia diventata il motore matematico dietro la rivoluzione dell'Intelligenza Artificiale generativa.

Il ruolo dell'entropia nell'Intelligenza Artificiale

Quando interagiamo con ChatGPT o altri Modelli Linguistici di Grandi Dimensioni (LLM), stiamo letteralmente dialogando con un sistema che calcola e manipola l'entropia di Shannon in tempo reale. Questi modelli non "comprendono" il testo nel senso umano del termine, ma utilizzano i fondamenti della teoria dell'informazione per prevedere, con estrema precisione statistica, quale parola (o token) dovrebbe seguire in una determinata sequenza.

Come i modelli linguistici (LLM) calcolano la probabilità delle parole

Sotto il cofano di un'Intelligenza Artificiale, la generazione del testo è un immenso calcolo probabilistico. Alla base di queste reti neurali vi sono miliardi di operazioni su vettori e pesi sinaptici (chi studia l'architettura di questi modelli spesso si affida a un calcolatore matrici per comprendere le trasformazioni lineari elementari che avvengono nei layer della rete). Quando l'IA deve scrivere una frase, assegna una probabilità a ogni possibile parola successiva presente nel suo vocabolario.

Se l'utente scrive "Il cielo è azzurro e il prato è...", il modello assegnerà una probabilità del 99% alla parola "verde". In questo istante, l'entropia della scelta è quasi nulla: il sistema è certo della mossa successiva.

Bassa entropia (testi banali) vs Alta entropia (allucinazioni dell'IA)

Nei software di IA, gli sviluppatori permettono agli utenti di regolare questa imprevedibilità attraverso un parametro chiamato Temperatura (un chiaro omaggio alla termodinamica). Modificare la temperatura significa alterare direttamente l'entropia del testo generato:

| Parametro "Temperatura" | Livello di Entropia | Caratteristiche del Testo Generato | Rischio |

|---|---|---|---|

| Bassa (es. 0.1 - 0.3) | Molto Bassa | Sceglie sempre la parola più probabile. Testo logico, ripetitivo e prevedibile. | Eccessiva banalità, stile robotico. |

| Media (es. 0.6 - 0.8) | Bilanciata | Alterna scelte ovvie a parole meno comuni. Flusso naturale e discorsivo. | Compromesso ideale per la maggior parte dei task. |

| Alta (es. 1.2 - 1.5) | Molto Alta | Sceglie spesso parole a bassa probabilità. Testo altamente creativo o caotico. | Allucinazioni (invenzione di fatti inesistenti) e frasi senza senso. |

Un'entropia troppo bassa genera testi noiosi e didascalici. Un'entropia troppo alta, forzando il modello a scegliere parole inaspettate per massimizzare la "sorpresa", porta l'IA a deragliare dalla logica, generando le famose allucinazioni, ovvero risposte grammaticalmente corrette ma fattualmente assurde.

Ottimizzare l'entropia per generare risposte umane

Il segreto per far sembrare un'IA "umana" risiede nell'ottimizzazione dell'entropia. Il linguaggio umano naturale non è né completamente prevedibile né totalmente caotico. Noi alterniamo cliché e frasi fatte (bassa entropia) a metafore improvvise o cambi di argomento (alta entropia). Gli algoritmi moderni utilizzano tecniche di campionamento (come il Top-p o Nucleus Sampling) per tagliare fuori le parole troppo improbabili, mantenendo un'entropia controllata che simula perfettamente la fluidità e la creatività del pensiero umano.

Abbandonando per un momento il mondo digitale dei bit e delle reti neurali, è fondamentale ricordare che questo concetto nasce nel mondo fisico. Vediamo come poter toccare con mano le leggi della termodinamica direttamente nella nostra cucina.

Esperimenti pratici sull'entropia da fare a casa

Per comprendere appieno l'entropia termodinamica, non è necessario disporre di un laboratorio avanzato. I fenomeni legati alla dispersione dell'energia e all'aumento del disordine dell'universo avvengono costantemente intorno a noi. La natura segue ciecamente il secondo principio della termodinamica, il quale stabilisce che, in un sistema isolato, l'entropia non può mai diminuire: essa definisce in modo inequivocabile la freccia del tempo.

Ecco tre semplici esperimenti per osservare questo principio in azione.

La goccia d'inchiostro in acqua calda e fredda

Questo è uno degli esperimenti visivi più affascinanti. Prendi due bicchieri trasparenti: riempi il primo con acqua molto fredda e il secondo con acqua calda. Lascia cadere contemporaneamente una singola goccia di inchiostro liquido (o colorante alimentare) in ciascun bicchiere, senza mescolare.

Noterai che nel bicchiere di acqua calda l'inchiostro si diffonde e colora l'intero volume in pochi secondi. Nel bicchiere di acqua fredda, invece, la goccia scende lentamente, creando filamenti che impiegano molto più tempo a mescolarsi. L'acqua calda possiede un'energia cinetica maggiore: le sue molecole si muovono e si scontrano freneticamente, accelerando il processo di diffusione. In entrambi i casi, l'inchiostro passa da uno stato altamente ordinato (una goccia concentrata) a uno stato disordinato (distribuito uniformemente). Non vedrai mai l'acqua colorata separarsi spontaneamente per ricreare la goccia originale: la freccia del tempo punta solo verso l'aumento dell'entropia.

Lo scioglimento del cubetto di ghiaccio e i passaggi di stato

Un altro classico esempio domestico riguarda i passaggi di stato della materia. Prendi un cubetto di ghiaccio dal freezer e appoggialo su un piattino a temperatura ambiente.

Nel ghiaccio, le molecole di acqua () sono bloccate in un reticolo cristallino rigido e ordinato. L'entropia del sistema è relativamente bassa. Man mano che il ghiaccio assorbe calore dall'ambiente, i legami si allentano e la struttura crolla, trasformandosi in acqua liquida. Le molecole ora sono libere di scorrere e muoversi in direzioni casuali: il numero di microstati possibili (le diverse disposizioni delle molecole) è aumentato drasticamente. L'entropia è cresciuta. Anche in questo caso, il calore fluisce spontaneamente dall'aria più calda al ghiaccio più freddo, obbedendo al secondo principio.

Mescolare un mazzo di carte ordinato: la probabilità in azione

L'entropia è, in fondo, una questione di probabilità statistica. Prendi un mazzo di 52 carte da poker nuovo, ordinato per seme (Cuori, Quadri, Fiori, Picche) e per valore (dall'Asso al Re). Questo è uno stato di bassa entropia perché esiste una sola configurazione su miliardi che presenta questo specifico ordine.

Inizia a mescolare il mazzo. Dopo poche mescolate, l'ordine svanisce. Continuando a mescolare per ore, giorni o anni, la probabilità che le carte tornino spontaneamente nell'ordine di fabbrica originale è praticamente nulla (esattamente 1 su , ovvero un numero con 68 zeri). Il mazzo non "vuole" essere disordinato; semplicemente, gli stati disordinati (alta entropia) sono infinitamente più numerosi e probabili dell'unico stato ordinato.

Questa ineluttabilità statistica ha spinto molti scienziati a domandarsi se esistesse una scappatoia. Un aspetto correlato e affascinante della storia della fisica è il tentativo teorico di "sconfiggere" questa legge suprema.

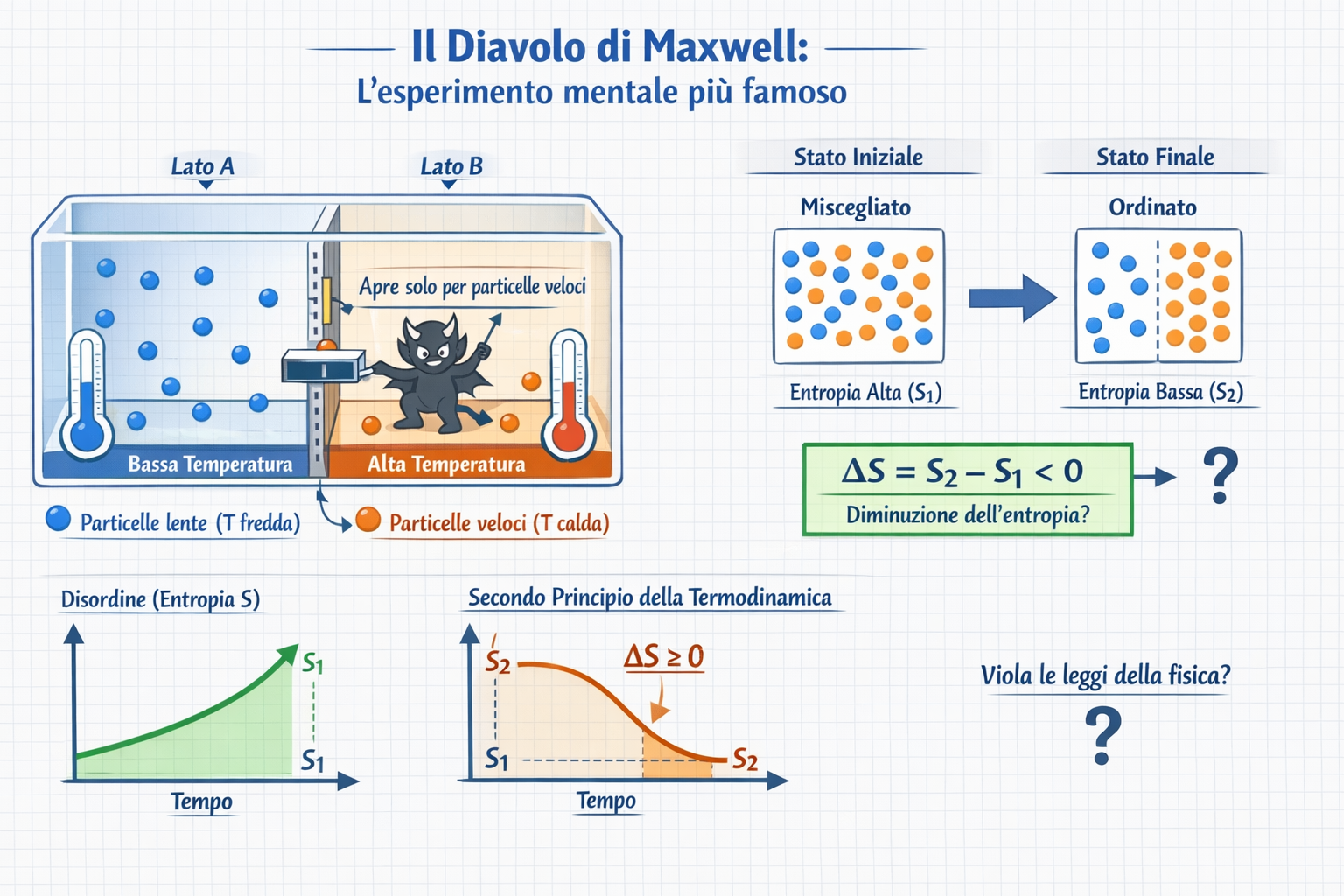

Il Diavolo di Maxwell: l'esperimento mentale più famoso

Nel 1867, il fisico scozzese James Clerk Maxwell propose un enigma che tormentò la comunità scientifica per oltre un secolo. Egli immaginò un modo teorico per ridurre l'entropia di un sistema chiuso senza compiere alcun lavoro meccanico, violando apparentemente in modo palese il secondo principio della termodinamica. Questa provocazione intellettuale passò alla storia come il Diavolo di Maxwell.

Come una creatura immaginaria potrebbe violare il Secondo Principio

Maxwell immaginò una scatola chiusa riempita di un gas a temperatura uniforme, divisa a metà da una parete isolante. In questa parete è presente una minuscola botola, governata da una creatura microscopica e intelligente (il "Diavolo", appunto).

Il gas è composto da molecole che si muovono a velocità diverse: alcune sono veloci (calde) e altre lente (fredde). Il Diavolo osserva le molecole che si avvicinano alla botola e agisce come un vigile urbano:

- Se una molecola veloce si avvicina dal lato destro, apre la botola e la fa passare a sinistra.

- Se una molecola lenta si avvicina dal lato sinistro, apre la botola e la fa passare a destra.

Separare le molecole calde da quelle fredde senza consumare energia

Poiché aprire e chiudere una botola priva di massa non richiederebbe teoricamente alcun dispendio di energia (o un dispendio trascurabile), il Diavolo riuscirebbe nel tempo a confinare tutte le molecole calde nella metà sinistra e tutte quelle fredde nella metà destra della scatola.

Il risultato? Una metà della scatola si scalderebbe e l'altra si raffredderebbe spontaneamente. Da questo gradiente di temperatura si potrebbe estrarre energia utile per far funzionare un motore all'infinito. Il sistema sarebbe passato da uno stato disordinato a uno ordinato, diminuendo la propria entropia totale. Se un simile meccanismo fosse realizzabile, potremmo scongiurare la teorizzata morte termica dell'universo creando energia dal nulla.

La risoluzione del paradosso: l'informazione ha un costo termodinamico

Il paradosso rimase irrisolto fino alla seconda metà del Novecento, quando fisici come Leo Szilard e Rolf Landauer introdussero la teoria dell'informazione nella termodinamica. La soluzione al rompicapo è geniale: il Diavolo, per poter smistare le molecole, deve misurare la loro velocità e memorizzare questa informazione nel suo cervello (o in un computer).

Il Principio di Landauer dimostrò matematicamente che la cancellazione di un bit di informazione dalla memoria del Diavolo (necessaria per fare spazio alle misurazioni successive) dissipa inevitabilmente una quantità minima di calore nell'ambiente, quantificabile dalla formula:

E = k_B * T * ln(2)

(Dove k_B è la costante di Boltzmann e T è la temperatura)

In sintesi, l'atto di processare e cancellare l'informazione genera entropia. L'entropia che il Diavolo riduce separando le molecole viene più che compensata dall'entropia generata dal suo stesso "cervello" per gestire i dati. Il Secondo Principio della Termodinamica era salvo: l'informazione non è un'entità astratta, ma ha un costo fisico e termodinamico ineludibile.

L'aumento dell'entropia e il destino dell'Universo

Come dimostrato dalla risoluzione del paradosso di Maxwell, l'inesorabile aumento dell'entropia termodinamica non ammette eccezioni su scala globale. Questa tendenza al disordine non si limita a sistemi chiusi in laboratorio, ma governa l'intero cosmo, dettando quella che i fisici chiamano la freccia del tempo. Mentre le leggi della meccanica classica sono simmetriche rispetto al tempo (funzionerebbero anche se il tempo scorresse all'indietro), l'entropia ci impone una direzione univoca: dal passato ordinato verso un futuro sempre più caotico.

Cos'è la Morte termica dell'universo (Big Chill)

Se l'universo è considerato un sistema isolato, la sua entropia continuerà a crescere fino a raggiungere un valore massimo. Questo scenario cosmologico, ampiamente accettato dalla fisica moderna, prende il nome di morte termica dell'universo (o Big Chill, il grande gelo).

Non si tratta di una morte causata da temperature roventi, ma dall'esaurimento di ogni gradiente termico. Attualmente, l'universo è ricco di contrasti: stelle caldissime irradiano energia verso lo spazio profondo, estremamente freddo. È proprio questa differenza di temperatura che permette all'energia di fluire e di compiere "lavoro" utile, alimentando la nascita di nuove stelle, la chimica planetaria e la vita stessa.

Il raggiungimento dell'equilibrio termico assoluto

Quando l'universo raggiungerà il suo stato di massima entropia, l'energia non sarà scomparsa (il primo principio della termodinamica garantisce la conservazione dell'energia), ma sarà diventata completamente inutilizzabile. Il cosmo sperimenterà un equilibrio termico assoluto.

In questo scenario remoto, possiamo aspettarci una sequenza di eventi ineluttabile:

- Spegnimento delle stelle: le ultime nane rosse esauriranno il loro combustibile nucleare.

- Decadimento della materia: la materia si disgregherà in un pulviscolo di particelle subatomiche e radiazioni.

- Evaporazione dei buchi neri: anche i colossi gravitazionali si dissolveranno nel nulla.

- Diluizione del calore: l'espansione dello spazio diluirà la radiazione residua fino a temperature vicine allo zero assoluto.

Quando non c'è più energia utilizzabile, non può avvenire alcun processo macroscopico. Il tempo, dal punto di vista degli eventi fisici, cesserà di avere un significato misurabile.

Curiosità spaziali: i Buchi Neri hanno un'entropia?

Spostando l'attenzione dall'intero cosmo ai suoi oggetti più misteriosi, sorge una domanda fondamentale: i buchi neri obbediscono alle leggi della termodinamica? Inizialmente, si pensava che un buco nero, inghiottendo materia ordinata, distruggesse l'entropia facendola scomparire dall'universo, violando così il Secondo Principio.

La scoperta di Stephen Hawking e la termodinamica dei buchi neri

Negli anni '70, i fisici Jacob Bekenstein e Stephen Hawking rivoluzionarono l'astrofisica dimostrando che i buchi neri possiedono un'immensa entropia termodinamica e persino una temperatura. Hawking dimostrò che essi emettono una debole radiazione termica (la radiazione di Hawking), destinata a farli "evaporare" in tempi inconcepibilmente lunghi.

La formula dell'entropia di Bekenstein-Hawking è considerata uno dei più grandi traguardi della fisica teorica, poiché unisce la meccanica quantistica, la relatività generale e la termodinamica:

S = (k_B * A * c^3) / (4 * G * ℏ)

Dove:

S = Entropia del buco nero

k_B = Costante di Boltzmann

A = Area dell'orizzonte degli eventi

c = Velocità della luce

G = Costante di gravitazione universale

ℏ = Costante di Planck ridotta

Perché l'entropia di un buco nero è proporzionale alla sua area

A differenza di un qualsiasi gas o solido sulla Terra, la cui entropia è proporzionale al volume, l'entropia di un buco nero è proporzionale alla superficie del suo orizzonte degli eventi (l'Area A nella formula). Questo ha dato origine al principio olografico: l'idea che tutta l'informazione tridimensionale inghiottita dal buco nero sia in realtà "codificata" sulla sua superficie bidimensionale, come in un ologramma.

Il paradosso dell'informazione quantistica

Questo legame tra gravità e termodinamica ha generato un acceso dibattito basato sulla teoria dell'informazione. Se lanciamo un'enciclopedia in un buco nero, la sua entropia di Shannon (la misura matematica dell'informazione contenuta nelle sue pagine) viene immagazzinata sulla superficie dell'orizzonte.

Tuttavia, quando il buco nero evapora tramite la radiazione di Hawking, emette particelle in modo apparentemente casuale. L'informazione originale sembra essere andata perduta per sempre, creando il celebre paradosso dell'informazione quantistica. Per modellare rigorosamente questi stati quantistici aggrovigliati e le relative probabilità, i fisici si affidano a complessi calcoli con matrici di densità (se sei uno studente o un professionista alle prese con l'algebra lineare alla base di questi concetti, uno strumento come un calcolatore matrici può semplificare notevolmente la verifica dei sistemi). Ad oggi, la risoluzione di questo paradosso rimane uno dei Santi Graal della gravità quantistica.

L'entropia in Biologia: la vita come lotta contro il caos

Se l'astrofisica ci mostra un universo dominato dal decadimento, la biologia sembra offrirci un'apparente anomalia. Una cellula, una pianta o un essere umano sono strutture incredibilmente complesse e ordinate. Come è possibile che la vita prosperi, generando ordine dal disordine, senza violare il secondo principio della termodinamica?

Come gli organismi viventi mantengono l'ordine interno

Nel 1944, il fisico quantistico Erwin Schrödinger pubblicò il saggio "Che cos'è la vita?", affrontando esattamente questo enigma. Schrödinger intuì che un organismo vivente evita il decadimento verso l'equilibrio termico (che per una cellula significherebbe la morte) mantenendosi costantemente in uno stato di non equilibrio.

Gli esseri viventi non sono sistemi chiusi, ma sistemi termodinamicamente aperti. Per mantenere la loro bassa entropia, devono scambiare continuamente materia ed energia con l'ambiente circostante.

Il metabolismo come processo di dissipazione di energia

La chiave di questo processo è il metabolismo. Gli organismi assumono energia a bassa entropia (altamente ordinata e utilizzabile) ed espellono energia ad alta entropia (degradata):

- Le piante assorbono i fotoni ad alta energia dal Sole (bassa entropia) e, attraverso la fotosintesi, costruiscono zuccheri complessi. Successivamente, irradiano calore nell'ambiente (alta entropia).

- Gli animali ingeriscono il cibo (macromolecole ordinate) e lo scompongono per estrarre energia chimica, espellendo calore, sudore e molecole semplici come anidride carbonica e acqua.

In pratica, la vita crea ordine locale a proprie spese, ma per farlo genera un enorme disordine nell'ambiente circostante. Il bilancio netto è sempre positivo: l'esistenza della vita accelera, paradossalmente, l'aumento complessivo del disordine dell'universo.

L'entropia negativa (Neghentropia) e l'evoluzione

Per descrivere questo fenomeno, Schrödinger coniò il termine di entropia negativa, oggi comunemente chiamata Neghentropia. Si può pensare alla neghentropia come alla "misura dell'ordine" che un organismo deve letteralmente "mangiare" dall'ambiente per compensare la propria entropia interna prodotta dai processi vitali.

Da questo punto di vista puramente fisico, l'intera evoluzione biologica di Darwin può essere riletta in chiave termodinamica. Le strutture biologiche sempre più complesse, dagli organismi unicellulari fino al cervello umano, non sono altro che "motori" evolutisi per dissipare l'energia in modo sempre più efficiente. La vita non è un'eccezione alle leggi fisiche, ma un'elegante e complessa danza sul bordo del caos.

Applicazioni in Economia, Finanza e Sistemi Complessi

Passando dal mondo biologico a quello delle interazioni umane, scopriamo che l'entropia non si limita a descrivere galassie in espansione o cellule in lotta per la sopravvivenza. Negli ultimi decenni, concetti come l'entropia termodinamica e, in particolare, l'entropia di Shannon sono diventati strumenti matematici fondamentali per studiare le dinamiche sociali e i sistemi complessi. Proprio come le particelle di un gas si scontrano scambiandosi energia, gli agenti economici (persone, aziende, istituzioni) interagiscono in reti intricatissime scambiandosi denaro, beni e informazioni.

L'imprevedibilità dei mercati finanziari misurata in entropia

Se osserviamo l'andamento febbrile delle borse valori, i concetti derivati dalla teoria dell'informazione diventano cruciali per comprendere il rischio. In finanza quantitativa, l'entropia di Shannon viene utilizzata per misurare il grado di incertezza e l'imprevedibilità dei rendimenti di un titolo azionario o di un intero indice. Un mercato ad alta entropia è dominato da fluttuazioni caotiche e "rumore bianco", rendendo la previsione dei prezzi futuri un'impresa quasi impossibile.

Al contrario, una bassa entropia indica un mercato con un trend chiaro e una forte direzionalità. Possiamo schematizzare il comportamento dei mercati in questo modo:

- Entropia Massima: I prezzi si muovono in modo completamente casuale (confermando l'ipotesi del mercato efficiente). Gli arbitraggi non sono possibili.

- Entropia Variabile: Si formano pattern nascosti e regolarità statistiche che gli algoritmi di machine learning cercano di sfruttare per generare profitti.

- Crollo dell'Entropia: Si verifica durante i crash finanziari o i momenti di panico generalizzato, quando tutti gli asset si muovono simultaneamente nella stessa direzione (correlazione perfetta) e il disordine apparente cede il passo a un ordine distruttivo.

Per modellare matematicamente questi scenari, gli analisti si affidano spesso ai processi di Markov, costruendo complesse matrici di transizione che calcolano le probabilità di passare da uno stato economico a un altro (ad esempio da una fase di recessione a una di espansione). Per gestire l'algebra lineare alla base di questi enormi set di dati probabilistici, l'uso di un calcolatore matrici risulta indispensabile per analisti e studenti di matematica finanziaria, permettendo di trovare autovalori e stati stazionari del mercato in modo rapido.

Entropia economica e distribuzione della ricchezza

Un aspetto correlato e altrettanto affascinante è l'applicazione del secondo principio della termodinamica alla macroeconomia. Se consideriamo il denaro circolante come l'equivalente dell'energia e le transazioni commerciali come le collisioni tra molecole, possiamo letteralmente calcolare l'entropia termodinamica di un intero sistema economico.

Studi pionieristici nel campo dell'econofisica hanno dimostrato matematicamente che, se un mercato viene lasciato a se stesso senza regolamentazioni, la distribuzione della ricchezza tende spontaneamente verso uno stato di massimo disordine probabilistico. Sorprendentemente, questo stato naturale non corrisponde all'uguaglianza perfetta, ma a una distribuzione asimmetrica analoga a quella dei gas.

| Termodinamica (Gas Ideale) | Economia (Sistema di Libero Mercato) |

|---|---|

| Molecole | Agenti economici (individui, imprese) |

| Energia cinetica | Denaro / Capitale accumulato |

| Collisioni elastiche | Transazioni commerciali (compravendita) |

| Distribuzione di Boltzmann | Distribuzione di Pareto (disuguaglianza della ricchezza) |

Nel mondo reale, questa tendenza entropica si traduce nella celebre Legge di Pareto: una ristretta minoranza del sistema finisce per concentrare la stragrande maggioranza della ricchezza, mentre la massa si spartisce le briciole. In questa ottica termodinamica, la tassazione progressiva e il welfare statale fungono da "lavoro esterno" applicato al sistema: un'iniezione di energia necessaria per abbassare l'entropia economica e contrastare la naturale deriva verso la disuguaglianza estrema.

Come i sistemi sociali tendono al disordine senza interventi esterni

Allargando ulteriormente la prospettiva, la freccia del tempo imposta dalle leggi della fisica si manifesta in modo inesorabile in ogni struttura sociale o istituzionale. Qualsiasi organizzazione umana, dalle grandi corporazioni multinazionali alle infrastrutture stradali di una metropoli, è un sistema altamente ordinato che richiede un costante e massiccio afflusso di energia (sotto forma di capitale, lavoro umano e materie prime) per mantenere la propria coesione.

Senza una manutenzione continua e un dispendio energetico mirato, ogni sistema sociale tende inesorabilmente al degrado: l'amministrazione efficiente si trasforma in burocrazia stagnante, i ponti si sgretolano, i database si corrompono e le società affrontano crisi strutturali. È il riflesso macroscopico e tangibile dell'aumento continuo del disordine dell'universo.

Proprio come le cellule biologiche descritte in precedenza, le civiltà umane "consumano" l'ordine del pianeta (bruciando combustibili fossili ed esaurendo risorse a bassa entropia) per generare ordine sociale locale, accelerando di fatto il degrado ecologico e termodinamico globale. Se spingiamo questo rigoroso ragionamento fisico alle sue estreme conseguenze, ogni sforzo umano, dalla costruzione delle piramidi alla creazione di internet, rappresenta un complesso ma transitorio meccanismo di dissipazione, destinato a dissolversi quando il cosmo stesso raggiungerà la morte termica dell'universo, l'equilibrio finale in cui il freddo e il caos regneranno sovrani e nessuna ulteriore elaborazione di informazioni sarà fisicamente possibile.

Autore

Danilo Vaccalluzzo

Sviluppatore e appassionato di matematica. Creatore di RisolutoreMatematico.it

Articoli Correlati

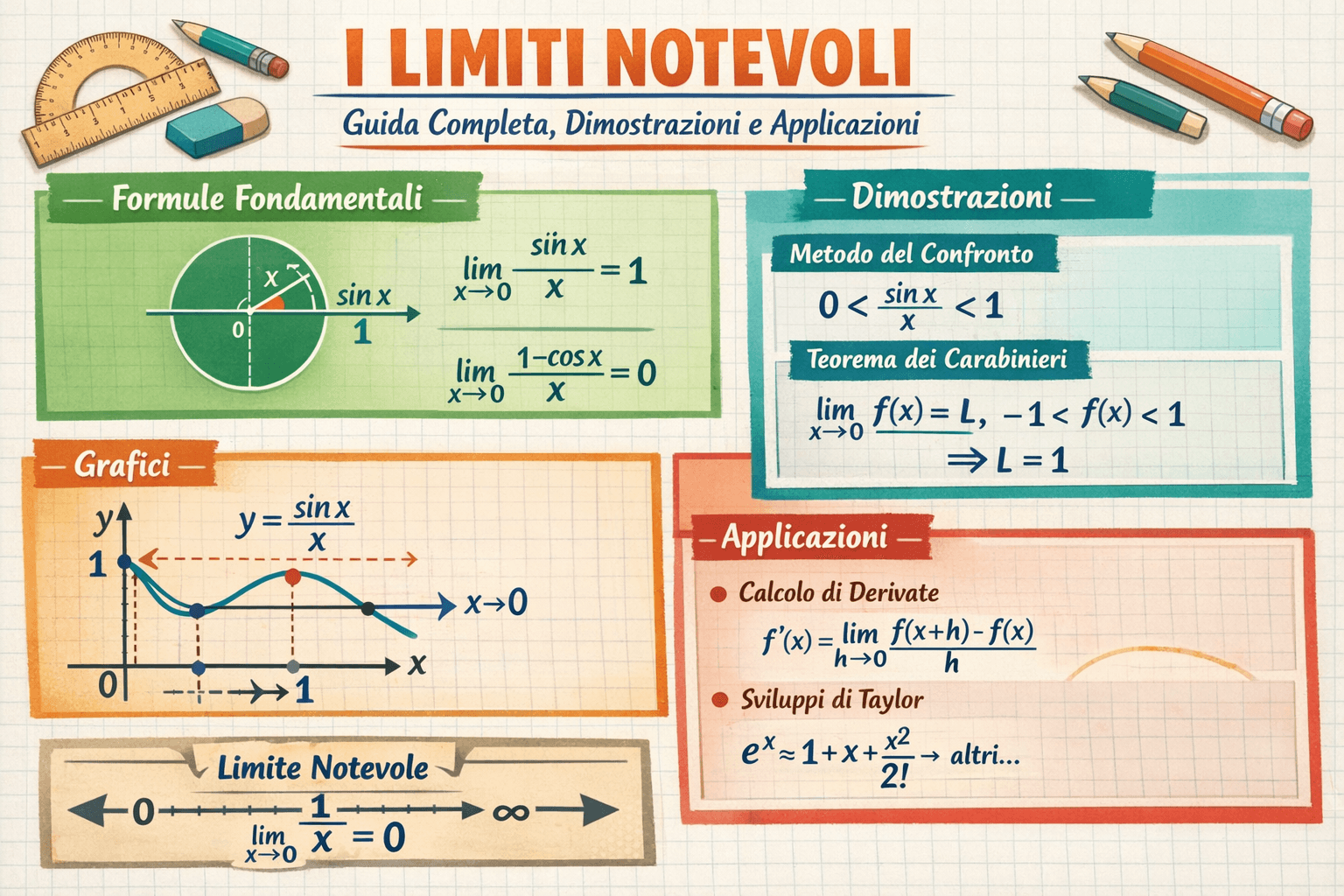

Limiti Notevoli: Guida Completa, Formule e Dimostrazioni

Scopri tutto sui limiti notevoli con questa guida completa. Impara le formule fondamentali, le dimostrazioni passo-passo e come applicarle per semplificare il calcolo dei limiti più complessi.

Serie armoniche: Definizione, Convergenza e Proprietà

Scopri tutto sulle serie armoniche: dalla definizione rigorosa alla dimostrazione della divergenza. Una guida completa con esempi, applicazioni e il confronto con la serie armonica generalizzata.

Come calcolare un integrale: Guida completa e facile con esempi

Vuoi imparare come calcolare un integrale senza commettere errori? In questa guida completa esploreremo le regole fondamentali, le tecniche avanzate e gli esempi pratici per padroneggiare l'analisi matematica.